GPT-6 vs GPT-5: Was gibt es Neues und lohnt sich ein Upgrade?

Jedes Mal, wenn OpenAI ein neues Modell ankündigt, breitet sich die gleiche Frage durch die Gemeinschaft aus: „Brauche ich das wirklich, oder kann ich bei dem bleiben, was funktioniert?“

Ich habe mich bei jeder Veröffentlichung seit GPT-3 die Frage gestellt. Und ehrlich? Die Antwort ist oft „abwarten und sehen“ gewesen. GPT-4 war großartig, aber nur inkrementell. GPT-5 löste einige Probleme mit dem logischen Denken, war aber nicht revolutionär.

GPT-6 ist anders.

Nach einem Durchsuchen aller verfügbaren Benchmarks, geleckten Dokumente und internen Quellen in der vergangenen Woche kann ich mit Zuversicht sagen: Dieses Upgrade unterscheidet sich von allem, was wir seit dem Übergang von GPT-3 zu GPT-4 gesehen haben. Aber lohnt sich das Upgrade angesichts der Kosten für Sie? Das hängt davon ab, was Sie bauen. Lassen Sie uns genau aufschlüsseln, was sich verändert hat.

Der Kopf-an-Kopf-Vergleich

Fangen wir mit den rohen Spezifikationen an:

Vergleich zwischen GPT-5.4 und GPT-6 (Spud)

Gesamtparameter: GPT-5.4 verfügt über ca. 1,8 Billionen Parameter, während GPT-6 eine Mixture-of-Experts (MoE)-Architektur mit 5 bis 6 Billionen Parametern nutzt – etwa dreimal so viele.

Aktivierte Parameter: GPT-5.4 aktiviert pro Vorwärtsdurchlauf etwa 200 Milliarden Parameter; GPT-6 aktiviert etwa 600 Milliarden (10 % seiner Gesamtparameter), ebenfalls eine Steigerung um den Faktor 3.

Kontextfenster: Wächst von 128.000 Token auf 2 Millionen Token, eine 15-fache Verbesserung.

Coding-Leistung: Mit GPT-5.4 als Basislinie erreicht GPT-6 die 1,4-fache Leistung.

Schlussfolgerungsleistung: Ebenso schneidet GPT-6 um den Faktor 1,4 besser ab als GPT-5.4.

Aufgabenabschlussrate der Agenten: GPT-5.4 erzielt 62 %, während GPT-6 etwa 87 % erreicht – eine relative Verbesserung um den Faktor 0,4 (also 40 %).

Trainingskosten: Sprung von etwa 600 Millionen US-Dollar auf etwa 20 Milliarden US-Dollar, eine 33-fache Steigerung.

Trainingshardware: Die Anzahl der verwendeten H100-GPUs steigt von ~30.000 auf ~100.000, eine Steigerung um den Faktor 3,3.

Eingabepreise: Bleibt unverändert bei 2,5 $ pro Million Tokens für beide Modelle.

Ausgabepreise: Ebenso unverändert bei 12 US-Dollar pro Million Tokens.

Die Zahlen erzählen nur einen Teil der Geschichte. Doch die eigentlichen Unterschiede gehen weitaus tiefer als die Anzahl der Parameter.

Architektur: Die wahre Geschichte

GPT-5.4 war im Wesentlichen GPT-5 mit Feinabstimmung. Es nutzte einen multimodalen Ansatz, bei dem Bild- und Videoverständnis an eine textzentrierte Basis angeklebt wurde. Es funktionierte gut genug, aber man konnte die Nähte spüren. Fordern Sie es auf, ein Diagramm zu erklären, und Sie erhielten nur eine Beschreibung. Fordern Sie es jedoch auf, das Diagramm tatsächlich zu analysieren, und die Ergebnisse wurden wackelig.

GPT-6 wirft das gesamte Paradigma über den Haufen. Die neue Symphony-Architektur verarbeitet alle Modalitäten – Text, Audio, Bilder, Video – von Anfang an in einem vereinheitlichten Vektorraum. Das ist nicht nur eine Ingenieuroptimierung. Es ist eine grundlegende Neuüberlegung darüber, wie multimodale KI funktionieren sollte.

Ich habe multimodale Modelle umfassend getestet. Der „aufgepfropfte“ Ansatz erzeugt immer Reibung. Das Modell sieht Text und Bilder als getrennte Dinge, die miteinander in Einklang gebracht werden müssen, nicht als verschiedene Ausdrücke derselben zugrundeliegenden Realität. Symphony beseitigt diese Trennung vollständig.

Schlussfolgern: Von der Mustererkennung zum eigentlichen Denken

Hier werde ich wirklich aufgeregt.

GPT-5.4 nutzt die standardmäßige autoregressive Generierung. Es vorhersagt das nächste Token anhand der vorangegangenen. Das ist alles. Deshalb kann es wunderschöne Prosa verfassen, die völlig falsch ist – es hat nie angehalten, sich selbst zu überprüfen.

GPT-6 implementiert dual-systematisches Denken. System-1 generiert schnell. System-2 überprüft anschließend, querverweist und korrigiert. Es ist der Unterschied zwischen einem Schüler, der eine Antwort plötzlich äußert, und einem, der nachdenkt, seine Arbeit prüft und dann antwortet.

OpenAI gibt an, dass die Halluzinationsrate mit dieser Architektur unter 0,1 % liegt. Wenn das zutrifft, rechtfertigt das allein die Aktualisierung für alle, die in regulierten Branchen wie Gesundheitswesen, Finanzen oder Recht tätig sind.

Agentenfähigkeiten: Vom Chatbot zum Kollegen

GPT-5.4 kann Tools und APIs aufrufen, doch dies erfordert sorgfältiges Prompting und das Modell gerät oft in mehrstufigen Arbeitsabläufen ins Stocken. Es ist ein fähiger Assistent, der genau angeleitet werden muss.

GPT-6 stellt die von OpenAI als „Super-Agent“ bezeichnete Funktionalität vor. Es kann mehrstufige Aufgaben planen, diese über verschiedene Anwendungen hinweg ausführen und Unterbrechungen bewältigen, ohne den Kontext zu verlieren. Du kannst es bitten, „unsere Top-3-Konkurrenten zu recherchieren, eine Wettbewerbsanalyse zu erstellen, Präsentationsfolien zu erstellen und den Entwurf per E-Mail an mein Team zu versenden“. Es erledigt das einfach.

Kontextbehandlung: Der praktische Unterschied

Das 128K-Kontextfenster von GPT-5.4 war nach 2025er Standards großzügig. Man konnte eine ordentlich große Code-Datei oder einige Kapitel eines Buches verarbeiten.

GPT-6s 2 Millionen Tokens ermöglichen es dir, dein gesamtes Code-Repository einzuspeisen. Das vollständige Produktanforderungsdokument. Jedes Support-Ticket aus dem letzten Monat. Vollständige rechtliche Verträge. Und das Modell behält die Kohärenz über all diese Inhalte hinweg.

Für Entwickler bedeutet dies echtes Verständnis auf Repository-Ebene. Für Forscher bietet dies die vollständige Papieranalyse ohne Chunking. Für Geschäftsanwender haben sie die Möglichkeit, in einem einzigen Gespräch alles zu verweisen, was Ihr Team in der vergangenen Woche besprochen hat.

Lohnt sich ein Upgrade?

Hier ist meine ehrliche Einschätzung basierend auf unterschiedlichen Anwendungsfällen:

Definitiv upgraden, wenn:

Du baust Agenten-Workflows, die mehrstufige Planung und Ausführung erfordern

- Sie arbeiten mit großen Codebasen oder Dokumenten, die 128K Token überschreiten

Halluzinationen sind derzeit ein Dealbreaker für Ihre Anwendung

Sie benötigen echtes multimodales Verständnis (Bild, Text und Video zusammen)

- Sie bauen für die Produktion im großen Maßstab und können sich die API-Kosten leisten

Warte und schaue, ob:

- Grundlegende Chat- und Q&A-Funktionen decken 90 % Ihrer Anwendungsfälle ab

Ihre Anwendungen laufen bereits problemlos mit GPT-5.4

- Du bist empfindlich gegenüber API-Latenz (wir kennen bislang noch keine realen Antwortzeiten aus der Praxis)

Ihr Team hat Ihre GPT-5.4-Workflows noch nicht vollständig optimiert.

Wahrscheinlich brauchst du es nicht, wenn:

Du nutzt hauptsächlich KI für einfache Inhaltserstellung oder grundlegende Unterstützung

- Kosten sind eine große Einschränkung (obwohl die Preise feststehen, ist die Versuchung, mehr Token zu nutzen, real)

Ihre Anwendungen laufen problemlos auf kleineren, schnelleren Modellen wie GPT-5 Nano oder GPT-4.1

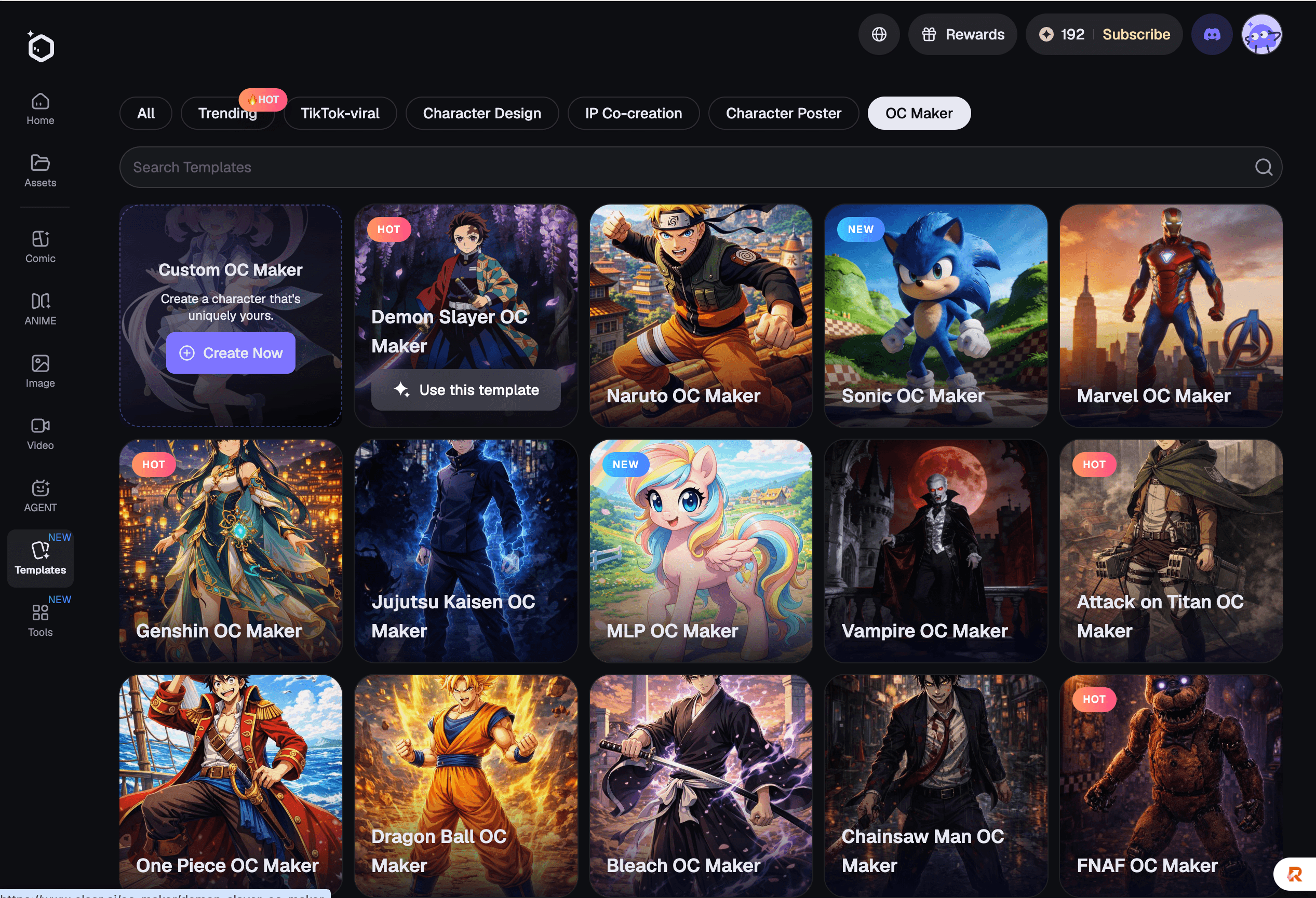

Treffen Sie klügere KI-Entscheidungen mit Elser AI

Nicht sicher, ob GPT-6 oder andere KI-Modelle zu Ihrem kreativen Arbeitsablauf passen? Sie sind nicht allein. Jede Woche bringen neue Tools, neue Behauptungen und neue Benchmarks. MitElser AI, du kannst Ideen umgehend in Anime-Videos und KI-generierte Bilder umwandeln, sie in realen Projekten testen und sehen, was wirklich für deine kreative Toolkette passt. Von der Szenenerstellung bis zur Charaktergestaltung hilft Elser AI dir beim Experimentieren, Iterieren und mit Zuversicht zu erstellen.