GPT-6 contre GPT-5 : Quoi de neuf et vaut-il la peine de mettre à niveau ?

Chaque fois qu'OpenAI annonce un nouveau modèle, la même question se propage dans la communauté : « Ai-je vraiment besoin de cela, ou puis-je me contenter de ce qui fonctionne ? »

Je me suis posé cette question à chaque version publiée depuis GPT-3. Et honnêtement ? La réponse a souvent été « attendre et voir ». GPT-4 était excellent mais incrémental. GPT-5 a résolu certains problèmes de raisonnement mais n'a pas été révolutionnaire.

GPT-6 est différent.

Après avoir fouillé dans tous les benchmarks disponibles, documents fuités et sources internes au cours de la semaine écoulée, je peux affirmer avec confiance que cette mise à jour est différente de tout ce que nous avons vu depuis la transition de GPT-3 à GPT-4. Mais vaut-il le coût de la mise à jour pour vous ? Cela dépend de ce que vous construisez. Détaillons exactement ce qui a changé.

La comparaison tête-à-tête

Commençons par les spécifications brutes :

Comparaison entre GPT-5.4 et GPT-6 (Spud)

Paramètres totaux : GPT-5.4 compte environ 1,8 trillion de paramètres, tandis que GPT-6 utilise une architecture de mélange d'experts (MoE) avec 5 à 6 trillion de paramètres – soit environ 3 fois plus.

Paramètres activés : GPT-5.4 active environ 200 milliards de paramètres par passage en avant ; GPT-6 active environ 600 milliards de paramètres (10 % de son nombre total), ce qui représente également une augmentation de 3 fois.

Fenêtre de contexte : Passe de 128 000 jetons à 2 millions de jetons, soit une amélioration de 15 fois.

Performances de codage : En utilisant GPT-5.4 comme référence, GPT-6 atteint 1,4 fois les performances.

Performances de raisonnement : De même, GPT-6 est 1,4 fois plus performant que GPT-5.4.

Taux de réalisation des tâches des agents : GPT-5.4 atteint 62 %, tandis que GPT-6 atteint environ 87 % — soit une amélioration relative de 0,4x (c'est-à-dire 40 %).

Coût de formation : Passe de environ 600 millions de dollars à environ 20 milliards de dollars, une augmentation de 33 fois.

Matériel d'entraînement : Le nombre de GPU H100 utilisés passe d'environ 30 000 à environ 100 000, soit une augmentation de 3,3 fois.

Tarification des tokens d'entrée : Reste stable à 2,5 dollars par million de tokens pour les deux modèles.

Tarification de la sortie : également inchangée à 12 dollars par million de tokens.

Les chiffres ne racontent qu'une partie de l'histoire. Mais les vraies différences sont beaucoup plus profondes que les nombres de paramètres.

Architecture : L'Histoire Vraie

GPT-5.4 était essentiellement GPT-5 avec un affinage. Il a utilisé une approche multimodale qui intégrait la compréhension des images et des vidéos à une base centrée sur le texte. Ça a fonctionné assez bien, mais on pouvait percevoir les raccords. Demandez-lui d'expliquer un diagramme, et vous obtiendrez une description basique. Demandez-lui d'analyser réellement le diagramme, et les choses deviennent instables.

GPT-6 rejette entièrement ce paradigme. La nouvelle architecture Symphony traite toutes les modalités — texte, audio, images, vidéo — dans un espace vectoriel unifié dès le départ. Ce n'est pas seulement une optimisation d'ingénierie. C'est une reconsidération fondamentale de la manière dont l'IA multimodale devrait fonctionner.

J'ai testé les modèles multimodaux de manière approfondie. L'approche « greffée » crée toujours des frictions. Le modèle considère le texte et les images comme des éléments distincts à réconcilier, et non comme des expressions différentes de la même réalité sous-jacente. Symphony élimine entièrement cette séparation.

Raisonnement : De la correspondance de motifs à la pensée réelle

C'est là que je deviens vraiment excité.

GPT-5.4 utilise une génération autorégressive standard. Il prédit le jeton suivant à partir des jetons précédents. C'est tout. C'est pourquoi il peut écrire une prose magnifique qui est totalement erronée — il n'a jamais pris la peine de se vérifier.

GPT-6 implémente un raisonnement à double système. Le Système 1 génère rapidement des réponses. Ensuite, le Système 2 vérifie, croise les informations et corrige. C'est la différence entre un étudiant qui énonce une réponse à l'improviste et un autre qui réfléchit, vérifie son travail, puis répond.

OpenAI affirme que les taux d'hallucinations sont inférieurs à 0,1 % avec cette architecture. Si c'est vrai, cela seul justifie la mise à niveau pour quiconque travaille dans des secteurs réglementés comme les soins de santé, la finance ou le droit.

Capacités de l'agent : Du Chatbot au Collègue

GPT-5.4 peut appeler des outils et des API, mais il nécessite un promptage attentif et s'égare souvent dans les flux de travail multi-étapes. C'est un assistant compétent qui a besoin d'être guidé pas à pas.

GPT-6 introduit ce qu'OpenAI appelle la capacité de « super agent ». Il peut planifier des tâches multi-étapes, les exécuter sur différentes applications et gérer les interruptions sans perdre le contexte. Vous pouvez lui demander de « rechercher nos trois meilleurs concurrents, rédiger une analyse concurrentielle, créer des diapositives de présentation et envoyer le brouillon par e-mail à mon équipe ». Il le fait tout simplement.

Gestion du contexte : La différence pratique

La fenêtre de contexte de 128 Ko de GPT-5.4 était généreuse selon les normes de 2025. On pouvait traiter un fichier de code de taille correcte ou quelques chapitres d’un livre.

Les 2 millions de jetons de GPT-6 vous permettent d'importer l'intégralité de votre référentiel de code, le document complet des exigences du produit, tous les billets de support du mois dernier ainsi que des contrats juridiques complets. Et le modèle maintient la cohérence sur l'ensemble de ces éléments.

Pour les développeurs, cela signifie une véritable compréhension au niveau du dépôt. Pour les chercheurs, une analyse de l’article complet sans découpage en morceaux. Pour les utilisateurs professionnels, la possibilité de référencer tout ce que votre équipe a discuté au cours de la dernière semaine dans une seule conversation.

Vaut-il la peine de mettre à niveau ?

Voici mon évaluation honnête basée sur différents cas d'usage :

Définitivement mettez à niveau si :

Vous construisez des flux de travail d'agents qui nécessitent une planification et une exécution multi-étapes

- Vous travaillez avec des bases de code ou des documents volumineux dépassant 128 000 jetons

- Les hallucinations sont actuellement un problème insurmontable pour votre application

- Vous avez besoin d'une compréhension multimodale authentique (image + texte + vidéo ensemble)

Vous construisez pour la production à grande échelle et pouvez vous permettre les coûts de l'API

Attendez et voyez si:

- Le chat basique et les questions-réponses couvrent 90 % de vos cas d'usage

Vos applications fonctionnent déjà parfaitement bien avec GPT-5.4

- Vous êtes sensible à la latence de l'API (nous ne connaissons pas encore les temps de réponse réels du monde réel)

Votre équipe n'a pas totalement optimisé ses flux de travail GPT-5.4

Probablement inutile si :

Tu utilises principalement l'IA pour la génération de contenu simple ou une assistance basique

- Le coût est une contrainte majeure (bien que les prix soient fixes, la tentation d'utiliser plus de tokens est réelle)

- Vos applications fonctionnent correctement sur des modèles plus petits et plus rapides comme GPT-5 Nano ou GPT-4.1

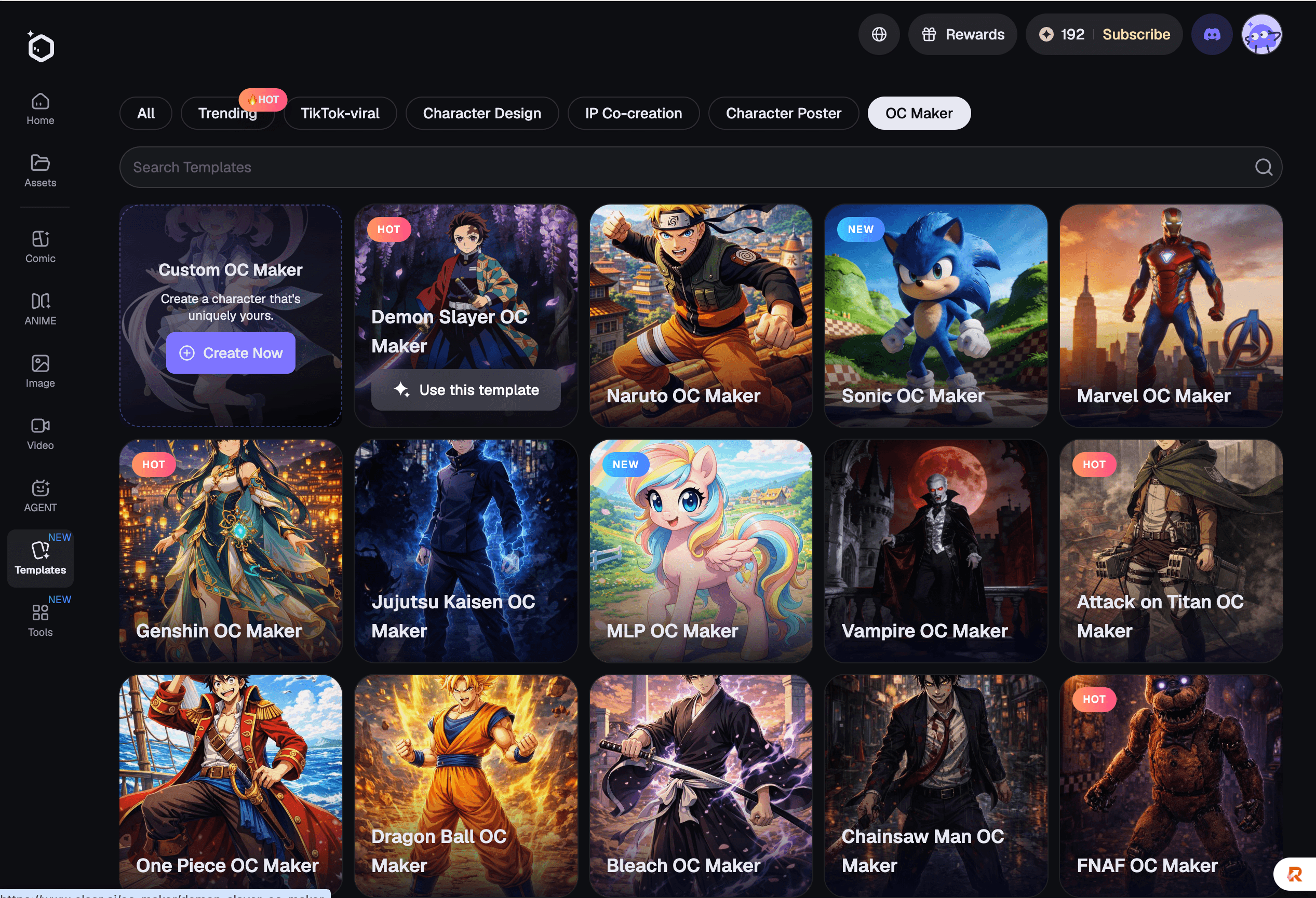

Prenez des décisions d'IA plus intelligentes avec Elser AI

Vous ne savez pas si GPT-6 ou d'autres modèles d'IA s'intègrent à votre flux de travail créatif ? Vous n'êtes pas les seuls. Chaque semaine apporte de nouveaux outils, de nouvelles revendications et de nouveaux points de référence. AvecElser IA, vous pouvez transformer des idées en vidéos d'anime et en images générées par IA instantanément, les tester dans des projets du monde réel et observer ce qui fonctionne vraiment pour votre pile créative. De la génération de scènes à la conception de personnages, Elser AI vous aide à expérimenter, itérer et créer en toute confiance.